“Mergulhe na história e na tecnologia do Ray Tracing, desde os algoritmos pioneiros de 1968 até a renderização neural em tempo real do hardware moderno. Descubra como a NVIDIA Blackwell, o PS5 Pro e a IA transformaram um sonho matemático na base do fotorrealismo digital.”

A história da computação gráfica é, em sua essência, uma busca incessante pela simulação da realidade. No coração dessa jornada está o Ray Tracing (traçado de raios), uma técnica que promete nada menos que a perfeição visual ao imitar o comportamento físico da luz. Diferente da rasterização tradicional — que projeta geometria 3D em uma tela 2D de forma aproximada — o Ray Tracing simula o trajeto inverso dos fótons: dos olhos do observador até as fontes de luz, interagindo com cada superfície no caminho.

Embora hoje, em 2026, consideremos reflexos realistas e iluminação global como padrões em jogos e filmes, essa tecnologia percorreu um longo caminho. De uma curiosidade acadêmica que levava dias para renderizar uma única imagem em 1968, o Ray Tracing evoluiu para se tornar a espinha dorsal da computação neural e do entretenimento em tempo real. Neste artigo, exploraremos as camadas técnicas, matemáticas e industriais dessa revolução.

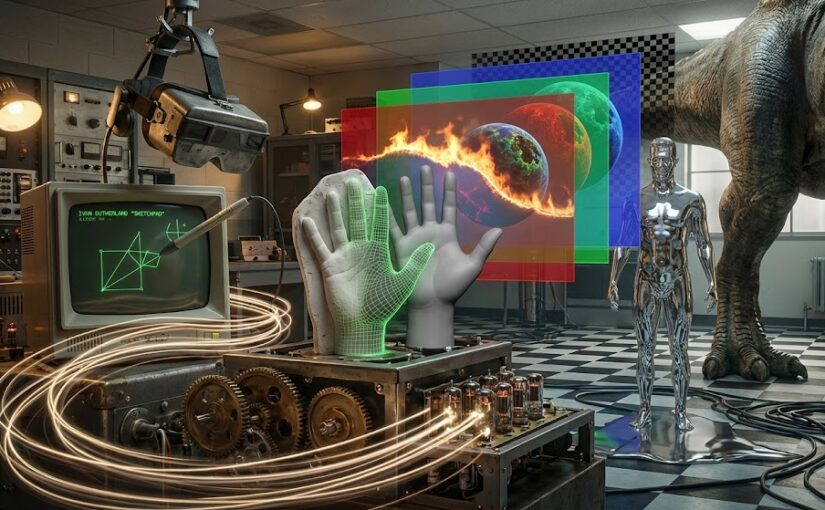

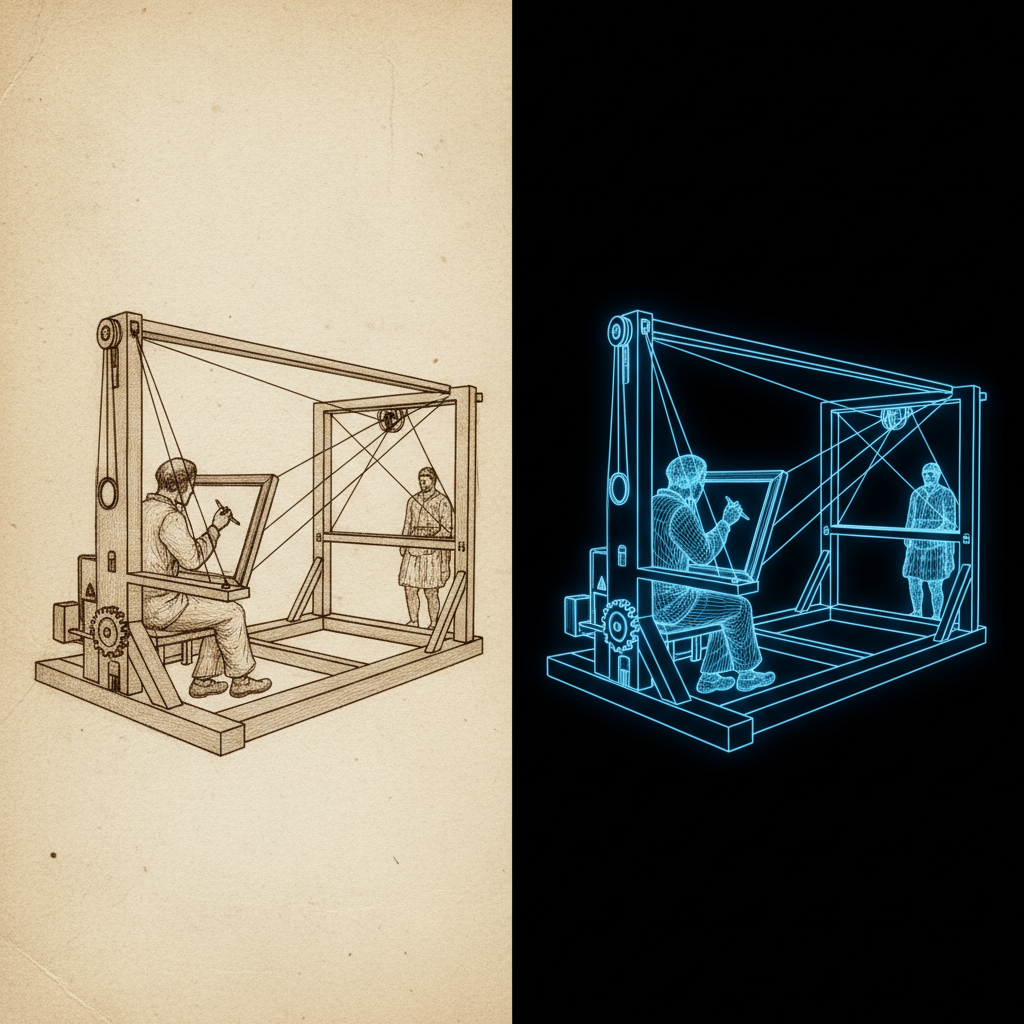

1. A Gênese: De Dürer a Arthur Appel

Para entender o futuro da renderização, precisamos olhar para o passado, muito antes dos computadores. Os fundamentos do Ray Tracing remontam ao Renascimento. Artistas como Albrecht Dürer, no século XVI, já utilizavam dispositivos mecânicos e fios para compreender a perspectiva, estabelecendo a ideia de que a visão é formada por raios que viajam do objeto até o olho. Dürer criou, analogicamente, o conceito de projeção que usamos hoje.

O Salto Digital de 1968

No entanto, a aplicação computacional desses conceitos só ocorreu em 1968, com Arthur Appel, da IBM. Em seu artigo seminal “Some Techniques for Shading Machine Renderings of Solids”, Appel introduziu o Ray Casting. Seu objetivo inicial não era o fotorrealismo extremo, mas resolver um problema prático: a determinação de superfícies visíveis (o problema da superfície oculta).

Ao lançar um raio através de cada pixel da tela virtual, o algoritmo de Appel podia determinar matematicamente qual objeto estava mais próximo do observador. Mais do que isso, ele introduziu a ideia de raios de sombra, verificando se aquele ponto de intersecção tinha uma linha de visão desobstruída para a fonte de luz. Foi o nascimento do sombreamento baseado em visibilidade física.

2. A Matemática da Luz: De Whitted a Kajiya

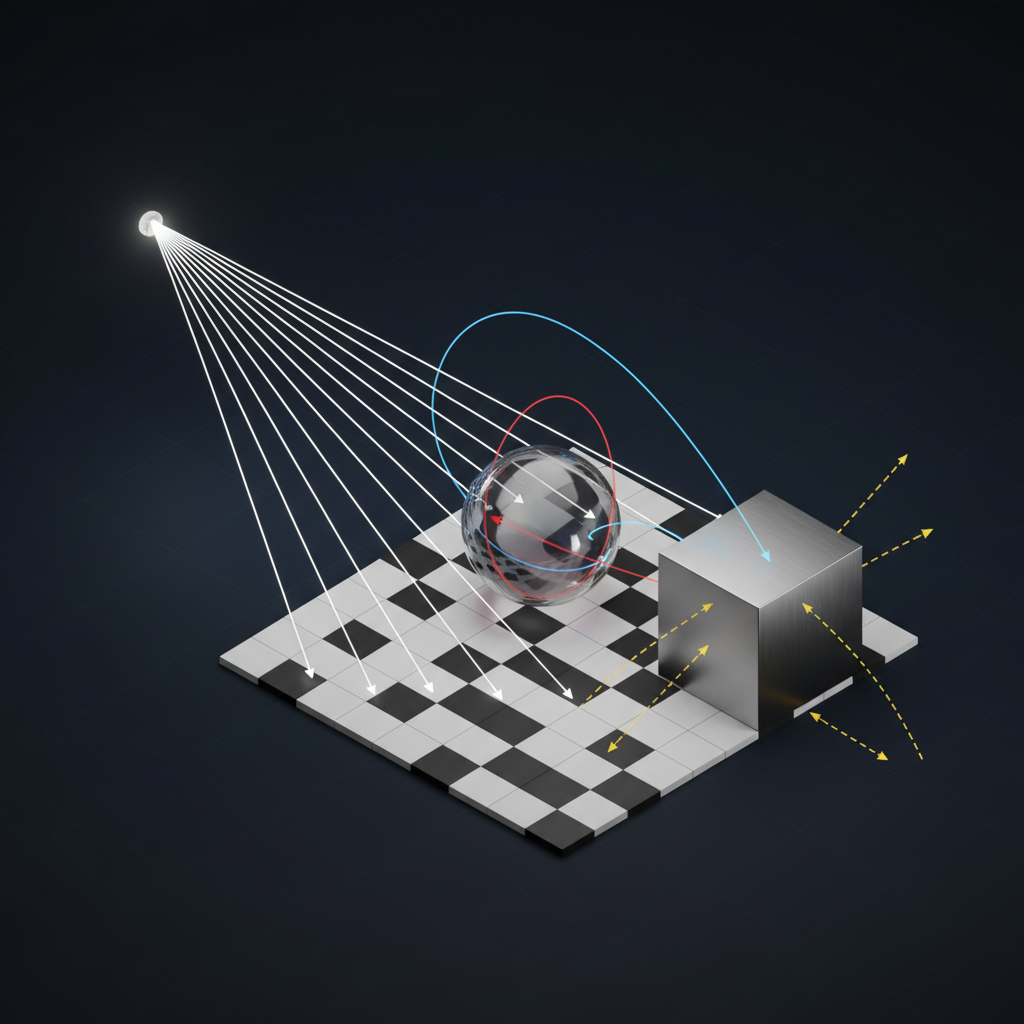

O verdadeiro salto para o fotorrealismo ocorreu na década de 1980. Até então, o Ray Casting lidava bem com a visibilidade, mas falhava em representar como a luz interage com materiais complexos. Em 1980, Turner Whitted (Bell Labs) publicou um modelo que mudaria tudo: o Ray Tracing Recursivo.

O Modelo de Whitted

Whitted percebeu que a luz não para ao atingir uma superfície. Ela reflete, refrata e se espalha. Seu algoritmo introduziu a geração de raios secundários a partir do ponto de impacto inicial:

- Raios de Reflexão: Calculados pelo ângulo de incidência, permitindo superfícies espelhadas perfeitas.

- Raios de Refração: Baseados na Lei de Snell, permitindo a simulação de vidro, água e materiais translúcidos.

- Raios de Sombra: Para verificar a oclusão da luz direta.

A demonstração icônica dessa tecnologia, o filme “The Compleat Angler” (1979), mostrou esferas transparentes e reflexivas que eram impossíveis de gerar com a rasterização da época. Contudo, o custo era proibitivo: um único quadro levava horas ou dias em mainframes VAX.

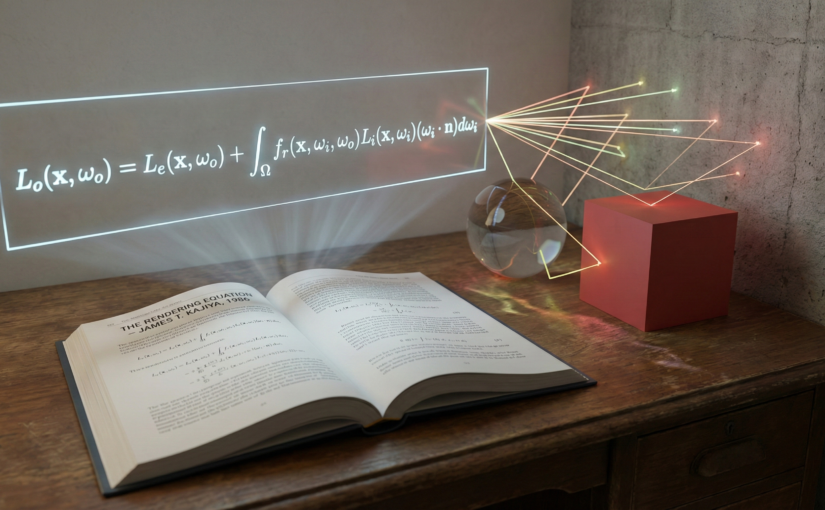

A Equação de Renderização (1986)

Se Whitted nos deu reflexos, James Kajiya nos deu a física completa. Em 1986, ele publicou “The Rendering Equation”, uma formulação integral que unificou todos os modelos de luz anteriores. Kajiya descreveu o equilíbrio de energia luminosa em uma cena, introduzindo o conceito de Path Tracing (Rastreamento de Caminho). Diferente do método determinístico de Whitted, o Path Tracing utiliza o método de Monte Carlo para disparar raios aleatórios que rebatem pela cena, capturando a Iluminação Global — a luz indireta que colore sombras e suaviza o ambiente, vital para o realismo que vemos hoje em motores como o Arnold ou o Cycles.

3. O Desafio da Performance: Estruturas de Aceleração

O maior inimigo do Ray Tracing sempre foi a complexidade computacional. Testar a intersecção de milhões de raios contra milhões de polígonos cria uma carga de processamento exponencial. Para tornar isso viável, cientistas da computação desenvolveram Estruturas de Aceleração Espacial.

O objetivo dessas estruturas é reduzir a complexidade da busca. Em vez de testar um raio contra cada triângulo da cena, o algoritmo testa contra grandes volumes que contêm a geometria.

BVH (Bounding Volume Hierarchy)

Hoje, a estrutura mais dominante, especialmente em hardware NVIDIA RTX e consoles como o PS5 Pro, é a BVH. Imagine encaixotar um carro em uma caixa grande. Se o raio não atingir a caixa, não precisamos testar o motor, os bancos ou o volante dentro dela. A BVH cria uma árvore hierárquica de caixas (AABBs), permitindo descartar vastas porções da cena rapidamente.

4. O Caminho do Cinema: De ‘Cars’ a ‘Monster House’

Durante anos, a Pixar e outros estúdios evitaram o Ray Tracing devido ao tempo de renderização, preferindo mapas de sombra e truques de rasterização (algoritmo REYES). A mudança de paradigma começou em 2006 com o filme “Cars”. A necessidade de renderizar reflexos precisos nas carroçarias metálicas dos personagens forçou a Pixar a integrar o Ray Tracing em seu pipeline.

No entanto, foi “Monster House” (2006) que marcou a história como o primeiro longa animado renderizado via Path Tracing completo usando o motor Arnold. Anos depois, a Disney, com o filme “Big Hero 6”, introduziu o Hyperion, um renderizador capaz de lidar com milhões de raios de luz rebatendo em uma cidade complexa, provando que o Path Tracing era o futuro inevitável da animação.

5. A Revolução do Tempo Real: Hardware e IA (2018-2026)

Até 2018, o Ray Tracing em tempo real era o “Santo Graal” inalcançável. O lançamento da arquitetura NVIDIA Turing (RTX 20) mudou as regras do jogo ao introduzir hardware dedicado: os RT Cores. Esses núcleos especializados aceleram o cálculo de intersecções BVH, liberando os sombreadores da GPU para outras tarefas.

A Era Neural: NVIDIA Blackwell e DLSS 4.5

Chegando a 2026, com a arquitetura Blackwell (RTX 5090), a força bruta do hardware se fundiu com a inteligência artificial. O problema do Ray Tracing é que lançar raios suficientes para uma imagem limpa é pesado demais. A solução foi o Denoising Neural.

Tecnologias como o DLSS (Deep Learning Super Sampling) evoluíram para não apenas aumentar a resolução, mas reconstruir a própria luz. O recurso de Ray Reconstruction utiliza IA treinada em supercomputadores para preencher as lacunas entre os raios, gerando imagens de qualidade cinematográfica a 60 quadros por segundo, algo impensável uma década atrás.

6. Consoles e Mobile: O Campo de Batalha de 2026

A democratização do Ray Tracing atingiu seu ápice com o PlayStation 5 Pro e os dispositivos móveis de 3 nanômetros.

- PS5 Pro e PSSR2: O console da Sony utiliza uma arquitetura híbrida AMD com aceleração de RT avançada. A chave, no entanto, é o PSSR2 (PlayStation Spectral Super Resolution), um upscaler baseado em Machine Learning que permite jogos como Resident Evil Requiem rodarem com Path Tracing completo.

- Guerra Mobile (Snapdragon vs. Apple): Em 2026, o Snapdragon 8 Elite da Qualcomm trouxe o Ray Tracing de iluminação global para o bolso, superando em benchmarks brutos o Apple A18 Pro. Jogos móveis agora exibem sombras suaves e reflexos reais, com chips consumindo poucos watts de energia, graças à litografia de 3nm.

7. Além do Entretenimento: Medicina e Indústria

O impacto do Ray Tracing transcende os jogos. Em 2025, vimos o surgimento do UltraRay, um framework que aplica Path Tracing à simulação de ultrassom. Ao tratar as ondas sonoras como raios que rebatem nos tecidos, médicos conseguem imagens sintéticas de precisão inigualável para treinamento de diagnósticos.

Na indústria automotiva, o design de LIDAR e faróis inteligentes utiliza simulações de Monte Carlo para garantir que carros autônomos possam “ver” através de neblina e chuva, modelando o espalhamento da luz em nível molecular.

Conclusão: O Futuro é Híbrido e Neural

De 1968 a 2026, o Ray Tracing evoluiu de um esboço matemático para a lente através da qual vemos mundos digitais. A barreira entre o “pré-renderizado” e o “tempo real” desapareceu. O futuro não reside apenas em mais raios, mas em IAs mais inteligentes que compreendem a física da luz. Estamos entrando em uma era onde a renderização não é apenas calculada, mas imaginada por redes neurais, completando o sonho de Dürer, Appel e Kajiya de uma simulação visual perfeita.

Se gostou do texto assista um vídeo no youtube que inspirou essa postagem!